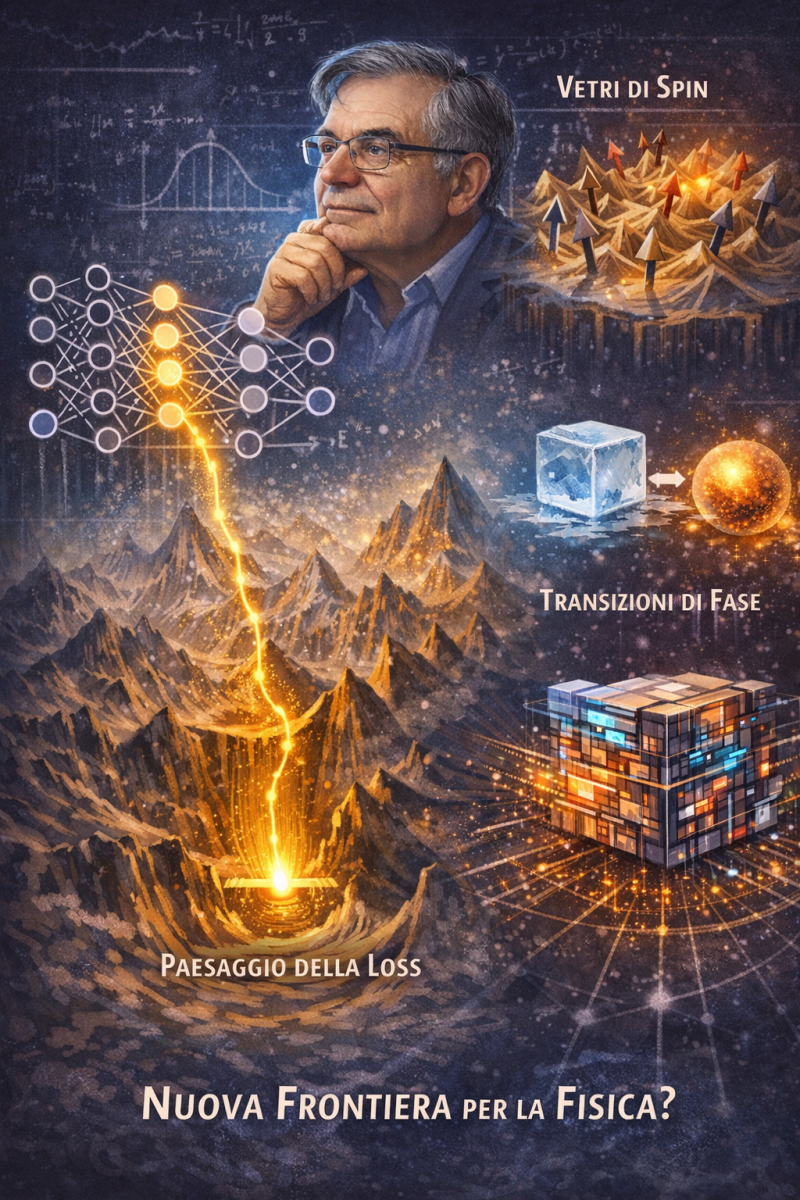

Come la fisica statistica e il Nobel a Giorgio Parisi ci aiutano a capire (e a non capire) l'intelligenza artificiale

«Per quanto possa sembrare incredibile, ci sfugge quello che accade precisamente dentro le reti neurali profonde addestrate con backpropagation».

Questa affermazione, scritta da Giorgio Parisi, suona quasi come un paradosso. Com'è possibile che una tecnologia onnipresente – dai motori di ricerca alle auto a guida autonoma – funzioni così bene, e allo stesso tempo non sia pienamente compresa dal punto di vista teorico?

Eppure è proprio così. E forse, il fatto stesso che a dirlo sia un Premio Nobel per la Fisica, ci suggerisce una pista: per capire l'intelligenza artificiale, potremmo aver bisogno degli occhi di un fisico.

Dal percettrone ai sistemi complessi

Negli anni ’80 e ’90 i fisici studiarono in profondità il Percettrone, il modello più semplice di rete neurale. Con un solo strato, la teoria è relativamente ben sviluppata: si possono analizzare capacità di apprendimento, limiti di separabilità e proprietà di generalizzazione. Era un sistema lineare, e in quanto tale, trattabile.

Quando però si passa alle reti multistrato profonde, con milioni o miliardi di parametri, il problema cambia natura. Non si tratta più di un semplice classificatore: diventa un sistema complesso ad altissima dimensionalità. E per i sistemi complessi, esiste una disciplina regina: la fisica statistica.

La loss come paesaggio di energia

Dal punto di vista matematico, l'addestramento di una rete neurale consiste nel minimizzare una funzione di costo, la cosiddetta loss. Un fisista leggerebbe questa funzione come una funzione di energia in uno spazio con milioni di gradi di libertà.

Immaginiamo quindi un paesaggio montuoso in uno spazio multidimensionale:

-le coordinate sono i pesi della rete

-l’altezza è il valore della loss

-l’addestramento (la discesa del gradiente) è una camminata in cerca delle valli più profonde di questo paesaggio

Il problema? Questo paesaggio è estremamente irregolare, un groviglio di catene montuose, con una quantità enorme di valli, cioè di minimi locali. L'intuizione classica suggerirebbe che cadere in una valle sbagliata (un "cattivo" minimo) porterebbe a un funzionamento scarso.

Eppure, sorprendentemente, l’ottimizzazione funziona, e anche bene.

Il parallelo con i vetri di spin

Il Nobel di Parisi è legato allo studio dei vetri di spin: sistemi magnetici "disordinati" dove le interazioni tra gli atomi sono in competizione, creando un paesaggio energetico estremamente complesso, un vero e proprio labirinto di valli profonde e stati metastabili.

Le analogie con le reti neurali profonde sono sorprendenti:

-entrambi hanno moltissimi gradi di libertà

-entrambi presentano paesaggi energetici complessi e irti di ostacoli

-entrambi ammettono moltissime soluzioni (stati) quasi equivalenti

Ma c'è una scoperta cruciale che arriva proprio dalla fisica dei vetri di spin, e che aiuta a risolvere il paradosso iniziale: in alta dimensionalità, la struttura globale del paesaggio conta più del singolo minimo locale. I "cattivi" minimi locali (quelli con loss molto alta) sono estremamente rari. La maggior parte dei punti di sella e dei minimi in cui si cade hanno un valore di loss sorprendentemente simile a quello del minimo globale. In pratica, se il paesaggio è abbastanza complesso, quasi tutte le valli sono abbastanza profonde.

Questo aiuta a spiegare perché le reti profonde, nonostante l'apparente caos, non solo convergono, ma lo fanno verso soluzioni che hanno ottime proprietà di generalizzazione.

Transformer, leggi di scala e fenomeni emergenti

Negli ultimi anni l’attenzione teorica si è spostata sui Transformer, l’architettura alla base dei moderni modelli linguistici di grandi dimensioni (come GPT).

Qui emergono fenomeni ancora più affascinanti. Aumentando in modo sistematico il numero di parametri e la quantità di dati, si osservano:

-leggi di scala regolari (scaling laws): le prestazioni migliorano in modo prevedibile, seguendo una potenza.

-capacità emergenti: oltre certe soglie dimensionali, compaiono improvvisamente abilità che nei modelli più piccoli erano assenti (come il ragionamento a più passi o la traduzione in contesti mai visti).

Il parallelo con le transizioni di fase in fisica è quasi inevitabile. In termodinamica, piccole variazioni di un parametro (come la temperatura) possono cambiare radicalmente lo stato della materia: da liquido a gas, da conduttore a superconduttore. Allo stesso modo, nei modelli linguistici, un aumento di scala può portare a un cambiamento qualitativo e improvviso nel comportamento del sistema.

Perché non abbiamo ancora una teoria completa?

Non è corretto dire che “non sappiamo nulla”. Conosciamo molto bene:

-l’algoritmo di ottimizzazione (la discesa del gradiente)

-il ruolo cruciale della sovraparametrizzazione (avere più parametri che dati, che invece di causare overfitting, aiuta la convergenza, in un fenomeno noto come double descent)

-diversi risultati matematici sulla capacità di generalizzazione

Ma manca ancora una teoria unificata, capace di prevedere a priori quali capacità emergeranno scalando il modello, o di spiegare perché certe architetture funzionano meglio di altre.

È una situazione che ricorda da vicino quella della turbolenza: le equazioni fondamentali (le equazioni di Navier-Stokes) sono note da oltre un secolo, ma il comportamento collettivo di un fluido turbolento resta una delle sfide irrisolte della fisica classica.

Una nuova frontiera per la fisica?

Forse il punto più interessante è questo: le reti neurali profonde non sono solo strumenti informatici.

Sono, a tutti gli effetti, nuovi oggetti fisici. Sono sistemi complessi ad altissima dimensionalità, creati dall'uomo, nei quali emergono strutture collettive e comportamenti non banali, proprio come in un vetro di spin o in un sistema magnetico.

Per questo motivo l’intelligenza artificiale sta diventando anche un laboratorio teorico per la fisica statistica. I concetti nati per studiare i materiali disordinati (paesaggi energetici, transizioni di fase, rottura di simmetria) si rivelano oggi strumenti preziosi per decifrare il funzionamento del cervello artificiale che stiamo costruendo.

Se Parisi ha ragione, il dialogo tra fisica e IA non è un ritorno nostalgico agli anni ’80, ma l’inizio di una nuova, feconda stagione di ricerca. Capire davvero cosa accade dentro queste reti neurali profonde non è solo una questione informatica: è una delle grandi sfide teoriche dei prossimi decenni, e la fisica ha molto da dire in merito.